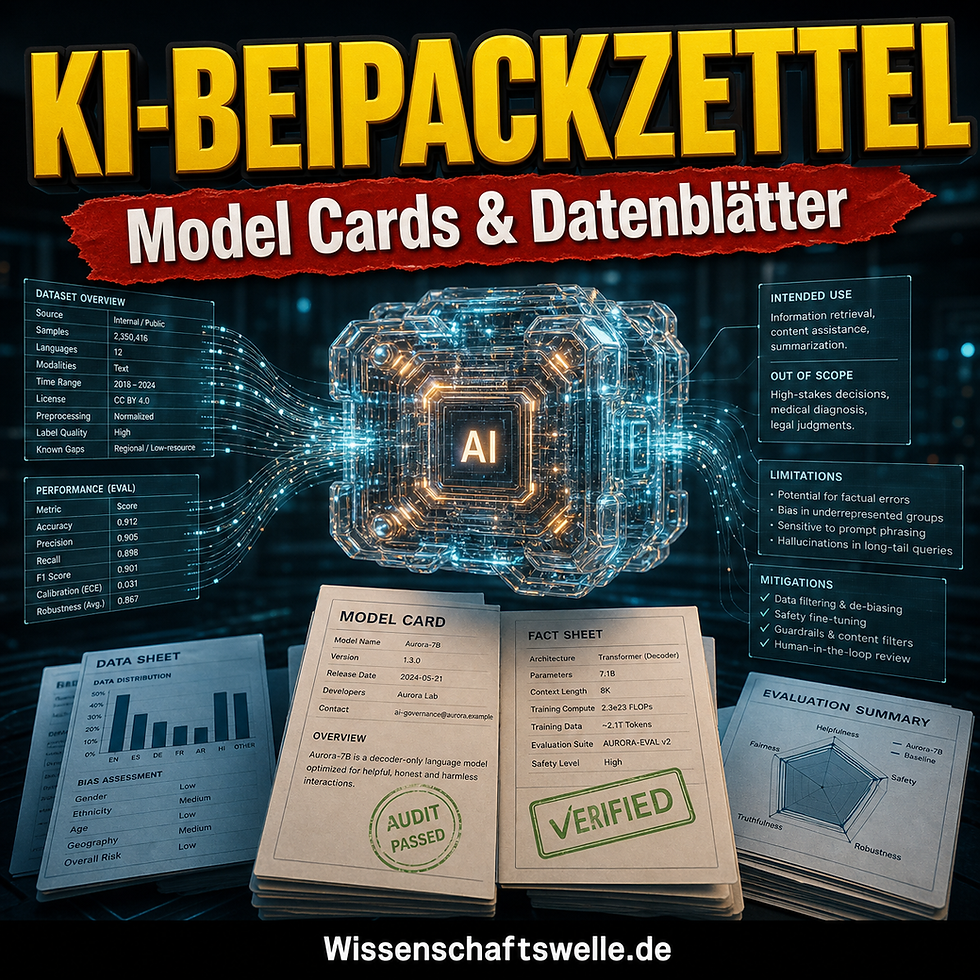

Vertrauen braucht Beipackzettel: Was Model Cards und Datenblätter über KI-Systeme sichtbar machen

- Benjamin Metzig

- vor 4 Stunden

- 6 Min. Lesezeit

Ein KI-Modell mit glänzenden Benchmark-Werten ist heute schnell gefunden. Viel schwerer ist eine banalere Frage: Woraus folgt eigentlich, dass dieses System für einen konkreten Einsatz taugt? Wer nur eine Zahl sieht, sieht fast nie den Kontext, aus dem sie stammt. Genau dort beginnt das Problem. Moderne KI wird oft in einer Form verbreitet, die Leistung behauptet, aber Entstehung, Datenbasis, Grenzen und Ausfallmuster nur ausschnittweise offenlegt. Model Cards und Datenblätter für Datensätze sind deshalb keine Randnotiz der Responsible-AI-Debatte. Sie sind ein Versuch, aus einer Blackbox wenigstens ein prüfbares Objekt zu machen.

Die Idee ist nicht neu, aber sie ist dringlicher geworden. Als Margaret Mitchell und Kolleg:innen 2019 das Format der Model Cards vorschlugen, zielten sie auf ein sehr konkretes Problem: Immer mehr Modelle wurden in sensiblen Bereichen eingesetzt, während Informationen über vorgesehene Nutzung, Evaluationsbedingungen und Leistungsunterschiede zwischen Gruppen im Dunkeln blieben. Schon ein Jahr zuvor hatten Timnit Gebru und Kolleg:innen mit Datasheets for Datasets dieselbe Lücke auf der Datenseite benannt. Wer nur das Modell dokumentiert, aber nicht die Daten, dokumentiert oft die Oberfläche statt der Ursache.

Zwei Dokumente, zwei Ebenen desselben Problems

Model Cards und Datasheets werden oft in einem Atemzug genannt. Das ist richtig, aber ungenau. Sie beantworten unterschiedliche Fragen.

Model Card: Was kann dieses Modell unter welchen Bedingungen leisten? · Typische Inhalte: Einsatzzweck, Grenzen, Evaluationsverfahren, Fehlermuster, Leistungswerte

Datasheet: Was ist das für ein Datensatz und wie ist er entstanden? · Typische Inhalte: Motivation, Zusammensetzung, Erhebung, Labeling, Ausschlüsse, empfohlene Nutzung

System Card: Wie verhält sich das gesamte System im realen Produktkontext? · Typische Inhalte: Fähigkeiten, Sicherheitsmaßnahmen, Risiken, Produktgrenzen, externe Tests

Das klingt trocken, ist aber redaktionell und politisch hochrelevant. Ein Modell kann auf einem Benchmark stark wirken und im Alltag trotzdem versagen, weil der Datensatz schief zusammengesetzt war, weil Labels fragwürdig vergeben wurden oder weil der Einsatzkontext ein anderer ist als der Testkontext. Dokumentation trennt diese Ebenen. Erst dadurch lässt sich überhaupt klären, ob ein Problem im Modell, im Datensatz oder im Produktdesign steckt.

Warum KI ohne Dokumentation strukturell zu viel Vertrauen verlangt

Jede komplexe Technik erzeugt Informationsasymmetrien. Bei KI sind sie besonders groß. Entwickler wissen, welche Datenquellen genutzt wurden, welche Vorverarbeitung stattgefunden hat, welche Metriken gewählt wurden und welche Fälle aus der Evaluation herausgefallen sind. Nutzer, Einkäufer, Journalisten, Aufsichtsbehörden und Betroffene wissen das meist nicht.

Genau deshalb ist das Thema mehr als ein Spezialproblem für Forscher. Es betrifft die Infrastruktur des Vertrauens selbst. Wer vernünftiges Vertrauen als Erkenntnisproblem ernst nimmt, landet schnell bei einer nüchternen Einsicht: Vertrauen ist dann rational, wenn Gründe zugänglich sind. Bei KI heißen diese Gründe oft nicht „Beweis“, sondern Dokumentation, Evaluationsprotokoll, Versionshistorie und offengelegte Grenzen.

Google formuliert das in seinem Responsible-AI-Material auffallend klar: Verantwortung für die Effekte eines KI-Systems setzt Transparenz darüber voraus, wie Modelle und Datensätze erstellt, trainiert und bewertet wurden. Das ist ein wichtiger Punkt. Transparenz ist hier nicht Selbstauskunft aus Nettigkeit. Sie ist eine Bedingung dafür, Verantwortung überhaupt zuordnen zu können.

Merksatz: Gute KI-Dokumentation beantwortet nicht bloß die Frage, was ein System kann.

Sie beantwortet vor allem, warum man einer bestimmten Leistungsbehauptung unter bestimmten Bedingungen glauben sollte.

Was gute Model Cards tatsächlich leisten

Die ursprüngliche Idee der Model Card war überraschend konkret. Das Format sollte nicht nur allgemeine Beschreibung liefern, sondern auch zeigen, wie sich Leistung über relevante Gruppen, Kontexte und Fehlerszenarien verteilt. Das ist entscheidend, weil Durchschnittswerte besonders gut darin sind, reale Probleme zu verstecken. Ein System kann insgesamt stark aussehen und dennoch bei bestimmten Altersgruppen, Sprachvarietäten, Hauttönen oder Nutzungskontexten deutlich schlechter funktionieren.

In der Praxis ist daraus inzwischen ein breiteres Ökosystem geworden. Auf Hugging Face sind Model Cards fester Bestandteil der Veröffentlichungslogik: als README.md mit Metadaten zu Modelltyp, Lizenzen, Datensätzen, vorgesehenem Einsatz und Evaluation. Das ist mehr als gute Ordnung. Es macht Modelle auffindbar, vergleichbar und teilweise reproduzierbar. Ein Nutzer kann dort nicht nur ein Modell herunterladen, sondern auch sehen, auf welcher Datenbasis es beruht, welche Aufgaben es beansprucht und wo Grenzen zumindest benannt werden.

Damit verschiebt sich der Charakter von Dokumentation. Sie ist nicht länger ein PDF am Rand des Projekts, sondern Teil der Distributionsinfrastruktur. Genau das fehlt in vielen Debatten: Transparenz wirkt erst dann, wenn sie an reale Such-, Beschaffungs- und Einsatzprozesse angeschlossen ist.

Warum Datasheets oft noch wichtiger sind als Model Cards

Viele KI-Fehler beginnen vor dem Modell. Sie beginnen beim Datensatz: bei der Auswahl dessen, was überhaupt gesammelt wurde, bei stillen Ausschlüssen, bei schief verteilten Populationen, bei fragwürdigen Labels, bei unklarer Einwilligung oder bei der Übertragung eines Datensatzes in einen Zweck, für den er nie gedacht war.

Darum war das Papier Datasheets for Datasets so folgenreich. Es argumentiert nicht abstrakt moralisch, sondern institutionell. Datensätze sollen so dokumentiert werden, wie technische Bauteile ihre Eigenschaften dokumentieren: mit Motivation, Zusammensetzung, Erhebungsprozess, empfohlenen Verwendungen und Grenzen. Das zwingt Projekte, Fragen früher zu stellen. Wer wurde erfasst, wer nicht, wer hat gelabelt, welche Annahmen stecken in den Kategorien, welche Risiken entstehen bei Weiterverwendung?

Das ist kein Detail. Gerade bei generativer KI wird oft über Modellgrößen, Parameterzahlen und Benchmarks gesprochen, während Datenherkunft erstaunlich vage bleibt. Dabei ist die Datenseite dort mindestens so zentral wie die Modellarchitektur. Ohne belastbare Datendokumentation bleibt die Debatte über Fairness, Urheberrecht, Privatsphäre oder Verzerrung oft auf Vermutungen angewiesen.

Vom Papierstandard zur realen Prüfbarkeit

Hier liegt die eigentliche Bewährungsprobe. Dokumente sind leicht zu fordern und schwer gut zu machen. Eine schlechte Model Card kann wie Transparenz aussehen und doch nur Marketing in Tabellenform sein. Sie kann veralten, Risiken kleinreden oder gerade die unangenehmen Grenzfälle auslassen. Dasselbe gilt für Datasheets.

Deshalb ist die richtige Frage nicht: Haben wir Dokumentation? Die richtige Frage lautet: Können Dritte mit dieser Dokumentation arbeiten?

Prüfbar wird KI erst dann, wenn mehrere Ebenen zusammenspielen:

ein Datasheet für die Datengrundlage

eine Model Card für das trainierte Modell

eine produktnahe System Card für reale Sicherheits- und Nutzungskontexte

versionierte Nachtests nach Updates

Berichte über Vorfälle und Schäden

Dass sich diese Logik ausweitet, sieht man an neueren Formaten. Die GPT-4o System Card etwa dokumentiert nicht nur Fähigkeiten, sondern auch Grenzen, Sicherheitsevaluationen und Produktkontext. Solche System Cards sind ein Schritt weiter als klassische Model Cards, weil sie anerkennen, dass Risiken selten im Modell allein entstehen. Sie entstehen im Zusammenspiel von Modell, Interface, Richtlinien, Nutzerverhalten und Einsatzumgebung.

Wer die Machtfrage von KI ernsthaft diskutieren will, landet daher zwangsläufig bei Governance. KI-Regulierung beginnt nicht mit einem Verbot, sondern mit Anforderungen an Nachweise, Prozesse und Einsatzgrenzen. Dokumentation ist in diesem Sinn kein weiches Add-on, sondern die minimale Form institutioneller Rechenschaft.

Wer KI prüfen kann, wenn die Unterlagen gut genug sind

Die Vorstellung einer einzigen Instanz, die KI „prüft“, ist irreführend. Reale Kontrolle ist verteilt.

Entwickler können interne Tests und bekannte Grenzen offenlegen. Betreiber und Einkäufer können prüfen, ob ein System überhaupt zum eigenen Einsatz passt. Auditoren und Aufsicht können Nachweise, Prozesse und Risikobehandlung vergleichen. Wissenschaft und Zivilgesellschaft können Replikationen, Gegenmessungen und methodische Kritik leisten. Journalismus und Betroffene sehen oft zuerst, wo ein System im Alltag schadet.

Das Entscheidende ist: Diese Akteure prüfen nicht dasselbe. Sie brauchen unterschiedliche Formen von Dokumentation. Eine Behörde will andere Dinge wissen als ein Open-Source-Forscher, ein Krankenhaus andere als eine Redaktion. Gute Transparenzstandards müssen deshalb anschlussfähig sein. Sie müssen nicht alles für alle erklären, aber genug offenlegen, damit verschiedene Prüfpfade überhaupt beginnen können.

An dieser Stelle wird der Zusammenhang zu Fehlern von KI-Systemen als Machtfrage sichtbar. Wenn ein System irrt, geht es nie nur um Technik. Es geht darum, wer widersprechen darf, wer Nachweise bekommt, wer haftet und wer im Zweifel beweisen muss, dass ein Schaden nicht bloß Pech war. Schlechte Dokumentation verschiebt diese Last fast immer zu den Schwächeren.

Transparenz endet nicht beim Release

Ein weiterer blinder Fleck vieler Debatten: Dokumentation wird oft so behandelt, als ginge es nur um Veröffentlichung. Doch ein Modell ist kein statisches Objekt. Es wird aktualisiert, feinjustiert, in neue Produkte eingebettet, mit Filtern, Prompts, Retrieval-Systemen und Nutzerdaten kombiniert. Was gestern dokumentiert wurde, kann morgen schon nur noch halb stimmen.

Darum ist Incident Reporting so wichtig. Die OECD hat 2025 mit ihrem Rahmen für KI-Vorfallsberichte versucht, genau diese Nachlaufphase zu standardisieren. Das ist konsequent. Wer nur den Bauplan dokumentiert, aber nicht das reale Scheitern, produziert Transparenz ohne Lernfähigkeit.

In diesem Punkt berühren sich KI-Governance und klassische Wissenschaftsnormen. Auch dort entstehen belastbare Aussagen nicht allein durch Veröffentlichung, sondern durch Nachvollziehbarkeit, Widerspruch und Spurensicherung. Protokolle, Forensik und offene Daten sind deshalb keine Parallelwelt zur KI-Debatte, sondern ihr institutioneller Verwandter.

Was ein guter Standard nie versprechen sollte

Es wäre allerdings naiv, Model Cards und Datasheets zu überschätzen. Sie lösen nicht das Problem geschlossener Trainingsdaten. Sie zwingen kein Unternehmen automatisch zu Ehrlichkeit. Sie verhindern keine regulatorische Lücke. Und sie machen aus einem riskanten System kein unproblematisches.

Aber sie leisten etwas, das oft unterschätzt wird: Sie verschieben die Beweislast ein Stück zurück zum Anbieter. Statt dass Außenstehende im Dunkeln mutmaßen müssen, welche Daten, Annahmen und Grenzen ein System hat, entsteht wenigstens ein dokumentierter Ausgangspunkt. Von dort aus kann man zustimmen, widersprechen, nachtesten oder strengere Nachweise verlangen.

Das ist weniger spektakulär als die großen Versprechen der KI-Branche. Gerade deshalb ist es so wichtig. Technologien werden selten zuerst durch Philosophie kontrollierbar. Sie werden durch Akten, Standards, Formate, Schnittstellen und Berichte kontrollierbar. Wer das langweilig findet, verwechselt Innovation mit Werbung.

Der eigentliche Fortschritt ist nicht Transparenz, sondern Widerlegbarkeit

Am Ende sollten wir Model Cards und Datenblätter nicht daran messen, ob sie ein beruhigendes Gefühl erzeugen. Gute Dokumentation soll nicht beruhigen. Sie soll andere in die Lage versetzen, Behauptungen zu prüfen. Der Maßstab ist nicht Schönheit, sondern Widerlegbarkeit.

Eine KI, die etwas über sich erzählt, ist noch nicht vertrauenswürdig. Vertrauenswürdiger wird sie erst, wenn dieses Erzählen präzise, versioniert, vergleichbar und für Dritte verwertbar ist. Genau darin steckt die politische Pointe des Themas. Wer KI prüfbar machen will, braucht nicht nur bessere Modelle. Er braucht bessere Unterlagen.

Kommentare