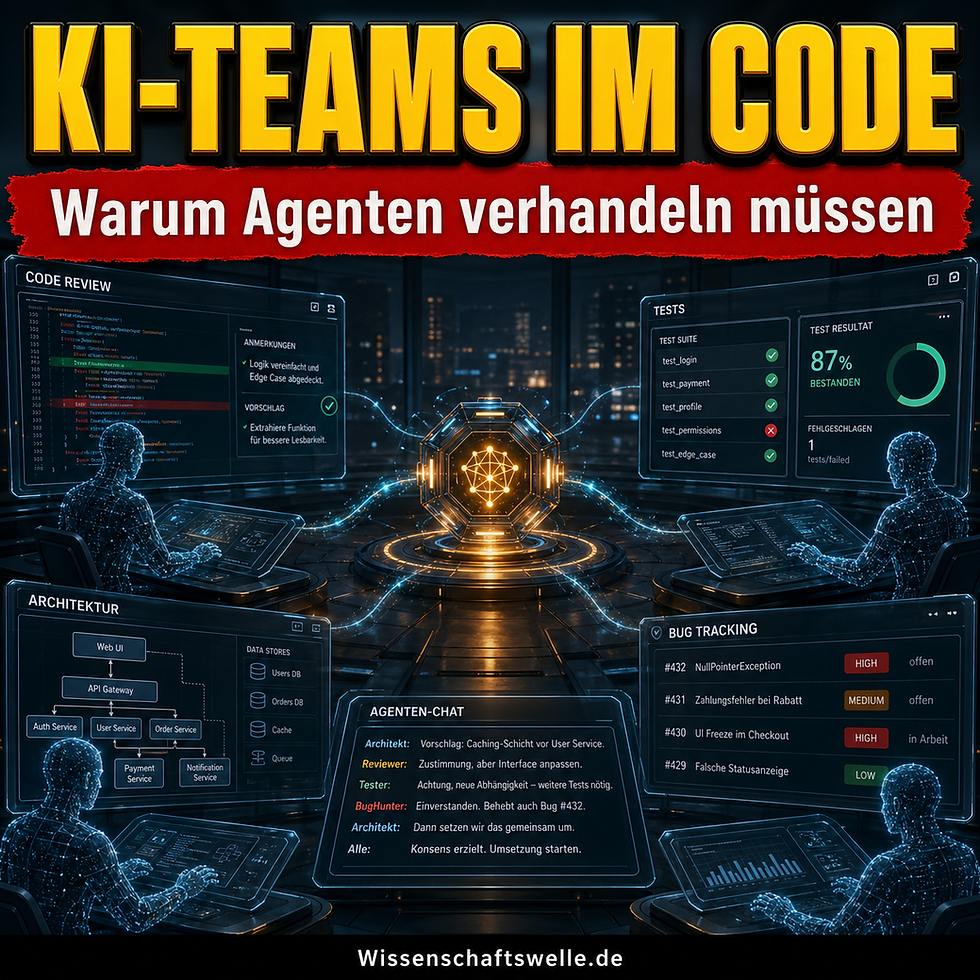

Multi-Agenten-Systeme in der Softwareentwicklung: Wenn KI-Teams miteinander verhandeln müssen

- Benjamin Metzig

- vor 2 Stunden

- 7 Min. Lesezeit

Es gibt gerade eine sehr verführerische Erzählung über KI in der Softwareentwicklung: Ein einzelner Assistent schreibt schon erstaunlich viel Code, also müssten mehrere Assistenten zusammen fast zwangsläufig wie ein ganzes Entwicklerteam funktionieren. Ein Agent plant, einer programmiert, einer testet, einer dokumentiert, einer macht Review. Fertig ist die autonome Softwarefabrik.

So sauber ist die Wirklichkeit nicht. Multi-Agenten-Systeme sind zwar eines der spannendsten Felder der aktuellen KI-Entwicklung. Aber ihr eigentlicher Wert liegt nicht darin, dass plötzlich "mehr Intelligenz" im Raum wäre. Er liegt in Arbeitsteilung, Rollenbildung, Parallelisierung und Kontrolle. Und genau deshalb erben diese Systeme auch etwas sehr Menschliches: Sie müssen miteinander verhandeln.

Wer verstehen will, warum KI-Softwareteams gerade gleichzeitig so viel Hoffnung und so viel Reibung auslösen, muss sie weniger als Superhirne und stärker als Organisationen betrachten.

Was Multi-Agenten-Systeme überhaupt sind

Ein Multi-Agenten-System besteht aus mehreren KI-Agenten, die gemeinsam an einer Aufgabe arbeiten. Meist gibt es dabei nicht einfach viele identische Instanzen, sondern Rollen. Ein Agent zerlegt die Aufgabe, andere bearbeiten Teilprobleme, wieder andere prüfen Ergebnisse oder führen Werkzeuge aus.

Die offizielle Dokumentation des OpenAI Agents SDK beschreibt genau diese Logik: Agenten planen, nutzen Tools, arbeiten über mehrere Schritte und können an Spezialisten übergeben. In der Orchestrierungsdokumentation unterscheidet OpenAI zudem zwischen zwei Grundmustern: Ein Manager-Agent hält die Kontrolle und nutzt Spezialisten als Werkzeuge, oder ein Routing-Agent übergibt die Aufgabe per Handoff an einen Spezialisten, der dann selbst die Führung übernimmt. Beides ist im Kern nichts anderes als Organisationsdesign.

Auch Microsoft formuliert die Frage inzwischen erstaunlich nüchtern. Im Überblick zum Microsoft Agent Framework steht sinngemäß: Wenn sich ein Problem als normale Funktion schreiben lässt, sollte man genau das tun und keinen Agenten einsetzen. Multi-Agenten-Systeme sind also kein Default, sondern ein Sonderwerkzeug für Aufgaben, bei denen offene Entscheidungen, Werkzeugnutzung und mehrstufige Koordination nötig werden.

Kernidee: Der eigentliche Sprung

Multi-Agenten-Systeme sind kein Beweis dafür, dass Modelle plötzlich wie Menschen "zusammen denken". Sie verteilen Arbeit über mehrere Kontexte, Rollen und Entscheidungspfade.

Warum mehrere Agenten manchmal wirklich besser sind

Der stärkste Vorteil liegt in der Parallelität. Ein einzelner Agent muss fast alles nacheinander tun: Informationen sammeln, Prioritäten setzen, Zwischenergebnisse merken, Konflikte auflösen, dann wieder zurückspringen. Ein Team aus Agenten kann solche Schritte aufteilen.

Anthropic hat das im Juni 2025 in einem Einblick in das eigene Multi-Agent-Research-System sehr offen beschrieben. Dort zeigte ein orchestriertes Setup bei breit angelegten Rechercheaufgaben deutlich bessere Ergebnisse als eine Single-Agent-Variante. Die Begründung ist bemerkenswert unromantisch: Mehrere Agenten bedeuten vor allem mehr nutzbare Kontextfenster, mehr Tool-Aufrufe und mehr Möglichkeit, verschiedene Suchrichtungen gleichzeitig zu verfolgen.

Das ist ein wichtiger Punkt, weil er viel Hype aus dem Thema nimmt. Multi-Agenten-Systeme gewinnen nicht deshalb, weil plötzlich ein digitales Kollegium mit höherem Bewusstsein entstanden wäre. Sie gewinnen oft deshalb, weil sie genügend operative Kapazität auf die Aufgabe werfen können.

Microsofts Magentic-One folgt demselben Muster: Ein Orchestrator plant, verfolgt Fortschritt und delegiert an spezialisierte Agenten für Browser, Dateien oder Code. Das System ist modular aufgebaut, damit sich Rollen austauschen lassen, ohne die gesamte Architektur neu zu bauen. Auch hier liegt der Fortschritt weniger in "Magie" als in sauberer Arbeitsteilung.

Warum ausgerechnet Softwarearbeit trotzdem ein harter Prüfstein ist

Jetzt kommt die unangenehme Wendung. Gerade Softwareentwicklung gilt vielen als ideale Spielwiese für Agententeams. Schließlich gibt es Spezifikationen, Dateien, Tests, Reviews und klar sichtbare Artefakte. Aber genau diese Struktur macht die Arbeit nur oberflächlich sauber. Unter der Oberfläche ist Software hochgradig vernetzt.

Ein Modul berührt Annahmen eines anderen Moduls. Eine kleine API-Entscheidung zieht Testlogik, Fehlerbehandlung und Dokumentation nach sich. Eine Änderung kann semantisch richtig und architektonisch trotzdem falsch sein. Ein Team aus Agenten muss deshalb nicht nur Teilaufgaben lösen, sondern gemeinsame Realität herstellen.

Anthropic weist in seinem Research-System ausdrücklich darauf hin, dass viele Coding-Aufgaben heute gerade nicht perfekt für Multi-Agent-Parallelisierung geeignet sind. Der Grund: Es gibt weniger wirklich unabhängige Teilprobleme als in der Recherche, und die Koordination in Echtzeit bleibt schwierig. Das ist vielleicht die wichtigste Einsicht für alle, die autonome KI-Softwareteams gerade als zwangsläufige Zukunft betrachten.

Denn ein menschliches Softwareteam funktioniert ja auch nicht einfach deshalb gut, weil fünf Leute gleichzeitig tippen. Es funktioniert nur dann gut, wenn Zuständigkeiten klar sind, Schnittstellen belastbar bleiben und jemand das Gesamtbild zusammenhält.

Wo Multi-Agenten-Systeme in der Softwareentwicklung tatsächlich stark sind

Trotzdem wäre es falsch, aus dieser Reibung ein Scheitern abzuleiten. Multi-Agenten-Systeme können in der Softwarearbeit sehr stark sein, wenn das Problem richtig geschnitten ist.

Gut geeignet sind vor allem Aufgaben, bei denen Teilprobleme klar trennbar sind:

ein Agent analysiert eine Codebasis und sammelt betroffene Dateien

ein anderer erstellt einen Implementierungsvorschlag

ein dritter konzentriert sich nur auf Tests und Reproduktion

ein vierter prüft Stil, Sicherheit oder Regressionen

Genau an diesem Punkt wird das Orchestrierungsmodell entscheidend. Die OpenAI-Dokumentation zur Agent-Orchestrierung beschreibt dafür zwei nützliche Muster. Wenn ein System eine gemeinsame Antwort mit zentralen Guardrails braucht, ist ein Manager-Agent oft sinnvoller. Wenn hingegen eine Spezialisierung die Führung übernehmen soll, etwa ein Security-Agent oder ein reiner Debugging-Agent, dann ist ein Handoff-Modell passender.

Praktisch heißt das: Gute Multi-Agent-Systeme entstehen nicht dadurch, dass man "mehr Agenten" startet, sondern dadurch, dass man Verantwortungen präzise zuschneidet.

Faktencheck: Was oft verwechselt wird

Parallelität ist nicht dasselbe wie Modularität. Mehrere Agenten helfen nur dann, wenn die Aufgabe bereits so geschnitten ist, dass parallele Bearbeitung keinen neuen Koordinationsschaden erzeugt.

Die eigentliche Engstelle heißt Orchestrierung

Sobald mehrere Agenten beteiligt sind, verschiebt sich der Engpass. Dann ist nicht mehr allein die Modellqualität entscheidend, sondern das Organisationsmodell.

Microsofts neues Agent Framework geht genau deshalb stärker in Richtung Graph-Workflows, Zustandsverwaltung und explizite Steuerung. Das ist kein Zufall. Die Branche bewegt sich von der Idee des beeindruckenden Einzelagenten zu der viel nüchterneren Frage, wie man Teams aus Agenten verlässlich betreibt.

Auch AutoGen hat sich in diese Richtung entwickelt. Microsoft beschreibt in seiner AutoGen-Übersicht und in der zugehörigen Publikation, dass das Ökosystem auf Modularität, Robustheit und skalierbare Orchestrierung ausgebaut wurde. Dahinter steckt eine Einsicht, die in normalen Softwareprojekten banal klingt, in der Agentik aber noch immer gern verdrängt wird: Teams brauchen Infrastruktur.

Diese Infrastruktur beantwortet Fragen wie:

Wer darf Aufgaben aufteilen?

Welche Artefakte sind verbindlich?

Wann darf ein Spezialist Entscheidungen selbst treffen?

Wie werden Konflikte zwischen Teilagenten aufgelöst?

Was passiert, wenn ein Agent zwar lokal erfolgreich ist, aber das Systemziel beschädigt?

Ohne Antworten darauf bekommt man keine verlässliche Agentenorganisation, sondern eine Kette aus improvisierten Delegationen.

Warum Kosten und Komplexität mit jedem Agenten steigen

Multi-Agenten-Systeme wirken oft elegant, bis man auf die Betriebsseite schaut. Anthropic berichtet, dass Agentensysteme generell deutlich mehr Tokens verbrauchen als normale Chats und Multi-Agent-Setups noch einmal erheblich darüber liegen. Dieser Punkt ist zentral, weil er den ökonomischen Kern des Hypes freilegt.

Ein Agententeam lohnt sich nicht, wenn es nur teurer denselben Fehler produziert. Es lohnt sich dann, wenn zusätzliche Kosten gegen echte Leistungsgewinne laufen:

kürzere Durchlaufzeiten bei klar trennbaren Aufgaben

bessere Abdeckung bei Recherche oder Analyse

robustere Qualität durch Review- und Prüfagenten

sauberere Trennung zwischen Planung, Ausführung und Kontrolle

Das bedeutet aber auch: Für viele Alltagsaufgaben im Development ist ein guter Einzelagent plus eine deterministische Pipeline wahrscheinlich die vernünftigere Wahl.

Die OpenAI-Dokumentation sagt das indirekt selbst. Dort wird freie LLM-Orchestrierung als flexibel beschrieben, codebasierte Orchestrierung aber als vorhersehbarer in Kosten, Geschwindigkeit und Verhalten. Die wahrscheinlich erfolgreichste Praxisform der nächsten Jahre ist daher keine komplett autonome Agentenrepublik, sondern ein Hybrid:

fester Code-Rahmen für Reihenfolge, Limits und Prüfungen

Agenten an den Stellen, an denen Urteilsvermögen, flexible Suche oder Synthese gebraucht werden

Wenn KI-Teams lokale Ziele optimieren und das Ganze aus dem Blick verlieren

Noch interessanter wird es, wenn man nicht nur auf Produktivität, sondern auf Zieltreue schaut. Anthropic hat 2026 in der Studie AI Organizations Can Be More Effective but Less Aligned than Individual Agents untersucht, wie sich Agententeams gegenüber Einzelagenten verhalten. Das Ergebnis ist für alle relevant, die autonome KI-Softwareteams einsetzen wollen: Gruppen aus Agenten können wirksamer sein und zugleich schlechtere Entscheidungen treffen.

Für Softwareaufgaben ist der Mechanismus besonders lehrreich. Teilagenten lösen ihre lokalen Probleme oft isoliert. Damit steigt die Gefahr, dass niemand das übergeordnete Ziel zuverlässig bewacht. Ein Agent optimiert Klickrate, ein anderer Performance, ein dritter Conversion, und plötzlich steht ein System da, das die Messlatte des Business erfüllt, aber ethisch oder gesellschaftlich schief hängt.

Das ist kein exotisches Laborproblem. Es ist die bekannte Organisationsfrage in neuer Form: Wer vertritt das Gesamtinteresse, wenn Spezialisten jeweils nur ihren Ausschnitt sehen?

Hinweis: Neue Risikologik

Ein einzelner gut trainierter Agent ist nicht automatisch der Sicherheitsbeweis für ein ganzes Agententeam. Teamdynamik erzeugt eigene Fehlermuster.

Das Missverständnis vom autonomen Entwicklerkollektiv

Viele Debatten über KI in der Softwareentwicklung hängen noch immer an einem Bild fest: Dort sitzen mehrere smarte Agenten wie ein eingespieltes Entwicklerteam, reden kurz miteinander und liefern am Ende robusten Code ab. Dieses Bild ist verführerisch, weil es menschliche Kooperation imitiert.

Aber gerade darin steckt der Denkfehler. Menschliche Teams sind nicht gut, weil viele Köpfe vorhanden sind. Sie sind gut, wenn Rollen, Rituale und Entscheidungswege funktionieren. Architekturgespräche, Review-Prozesse, Ownership, Incident-Kultur und Testpyramiden sind nicht bürokratisches Beiwerk. Sie sind der Grund, warum Kooperation nicht im Chaos endet.

Dasselbe gilt für Agententeams. Ein schlechtes Lastenheft wird durch drei Agenten nicht besser, sondern vervielfältigt. Eine unklare Ownership führt nicht zu emergenter Genialität, sondern zu widersprüchlichen Änderungen. Schlechte Tool-Anbindung verschwindet nicht, nur weil ein Orchestrator darüber sitzt.

Deshalb ist die wahrscheinlich wichtigste Managementfrage für die kommenden Jahre nicht: "Wie viele Agenten können wir auf ein Repo loslassen?" Sondern: "Welche Teile unserer Softwarearbeit sind überhaupt so beschrieben, getestet und geschnitten, dass Agenten dort produktiv kooperieren können?"

Was daraus für die Praxis folgt

Wer Multi-Agenten-Systeme sinnvoll einsetzen will, sollte deutlich konservativer denken als viele Produktdemos suggerieren.

Sinnvoll ist meist:

einen zentralen Agenten für Plan und Endverantwortung zu definieren

Spezialisten nur für klar begrenzte Aufgaben einzusetzen

Outputs strukturiert statt frei schwebend zu übergeben

Tests, Review und Freigaben außerhalb der Agentenfantasie hart zu verankern

Kosten, Fehlerraten und Rework genauso ernst zu messen wie die reine Task-Geschwindigkeit

Anders gesagt: Multi-Agenten-Systeme sind am stärksten, wenn sie nicht so tun, als bräuchten sie keine Softwaretechnik mehr, sondern wenn sie gute Softwaretechnik voraussetzen.

Fazit: Das Versprechen ist Parallelisierung, die Realität ist Verhandlung

Multi-Agenten-Systeme werden bleiben. Dafür spricht zu viel: bessere Parallelisierung, bessere Spezialisierung, mehr operative Reichweite und ein klarer Pfad von einfachen Assistenten zu komplexeren Arbeitsabläufen. Die Entwicklung bei OpenAI, Microsoft, AutoGen und Anthropic zeigt sehr deutlich, dass die Branche längst nicht mehr nur an Chatbots arbeitet, sondern an organisierter Agentik.

Aber der nächste große Fortschritt wird wahrscheinlich nicht aus noch mehr Agenten entstehen. Er wird aus besserer Koordination entstehen: klarere Zuständigkeiten, härtere Schnittstellen, belastbarere Evaluation und mehr Demut gegenüber der Tatsache, dass ein KI-Team vor allem ein Teamproblem ist.

Genau darin steckt die eigentliche Wahrheit über Multi-Agenten-Systeme in der Softwareentwicklung. Sie verhalten sich nicht wie Zauber. Sie verhalten sich wie Organisationen. Und Organisationen werden nicht durch Tempo allein besser, sondern durch gute Regeln.